ContextLoader:业务知识网络的结构化召回范式

文章贡献者:陈储培、李倩兰

摘要

随着大语言模型在复杂业务场景中的广泛应用,如何有效组织和管理上下文信息已成为提升推理质量的关键挑战。传统的检索增强生成(RAG)方法通过语义向量匹配实现知识召回,但在处理结构化业务知识网络时,面临召回粒度粗糙、推理路径割裂、上下文膨胀等根本性局限。本研究提出 ContextLoader 框架,一种面向业务知识网络的结构化上下文管理方案。该框架通过两个互补机制——Trim(相关性裁剪)和 Toon(Token-Optimized Notation,标记优化表示)——在工具返回结果写入 LLM 上下文前进行结构化质量提升。

为确保研究结论的可靠性和可推广性,本研究设计了两项独立的实验验证:(1)在 AWorld 开源智能体框架中,对比 ContextLoader 与外部向量检索服务(Dify Baseline);(2)在 Dify 平台内部,对比 ContextLoader 与平台原生向量检索工具。两项实验均在 MSFAgentBench 基准数据集上进行。实验结果表明:AWorld 环境下,ContextLoader(完整配置)相对 Dify Baseline 提升 14.0 个百分点,准确率达到 92.9%;Dify 平台环境下,ContextLoader(启用 Trim 和 Toon)准确率从 70.4% 提升至 84.5%。两项独立实验在不同环境下取得的显著提升,有力地支持了结构化上下文管理相对于传统向量检索的系统性优势。此外,ContextLoader 将 Token 消耗降低 27.5%-33.2%,SQL 调用减少 33.1%-58.1%,SQL 错误率从 7.3% 降至 1.2%。

关键词:结构化召回;上下文管理;大语言模型;智能体系统;业务知识网络

目录

1. 引言

1.1 研究背景与动机

在大语言模型驱动的智能体系统中,知识召回是支撑复杂推理任务的核心能力。当前主流的知识召回方案以检索增强生成(Retrieval-Augmented Generation, RAG)为代表,通过向量数据库实现语义相似度匹配,将相关文档片段注入模型的上下文窗口。这一范式在开放域问答、文档理解等任务中表现出色,已成为工业界广泛采用的技术方案。

然而,当应用场景从非结构化文档转向业务知识网络——即包含多表关联关系、层级化 Schema、对象实例和数值约束的结构化数据体系时,传统 RAG 方案暴露出三类结构性局限:

-

召回粒度粗糙(Coarse Retrieval Granularity)

基于语义向量的片段匹配难以感知数据模型的 Schema 层级关系。当用户查询涉及特定字段或表关联时,向量检索往往召回字段语义相似但结构上无关的内容,导致模型需要额外推理来排除无关信息。

-

推理路径割裂(Fragmented Reasoning Path)

在多步推理任务中,每一轮工具调用的返回结果通常以平铺形式追加到上下文中。这种组织方式缺乏对证据链的结构化编排,使得关键证据容易被冗余内容淹没,增加了模型的认知负担。

-

上下文膨胀失控(Context Explosion)

原始的结构化数据(如 JSON 对象或表格行)直接写入上下文时,包含大量冗余的语法标记和重复的结构信息。在需要多轮工具调用的复杂任务中,Prompt Token 数量迅速膨胀,超出模型有效注意力范围,直接影响推理的正确性。

这些局限性不仅仅是效率问题——实验证据表明,上下文膨胀可能导致复杂任务的推理完全失败。

1.2 研究问题与贡献

本研究旨在解决以下核心问题:如何为业务知识网络上的多步推理任务设计更有效的上下文管理机制?

本研究提出 ContextLoader 框架,其核心思路是将知识召回从"向量检索+文档拼接"的静态范式,升级为"Schema 定位 → 对象查询 → 结构化整理"的动态收敛路径。该框架通过两个互补机制实现上下文质量的系统性提升:

- Trim(相关性裁剪):基于当前任务状态的相关性评估,过滤工具返回结果中的低价值内容

- Toon(Token-Optimized Notation):将筛选后的内容转换为 LLM 友好的紧凑结构化格式

本研究的贡献可概括为:

- 方法论贡献:提出 Trim 和 Toon 两个互补机制,分别解决"放什么进来"和"怎么表达"两个核心问题

- 系统实现:在两个独立平台(AWorld 和 Dify)上实现了完整的 ContextLoader 集成

- 实验验证:通过两项独立实验,系统验证了框架相对于向量检索基线的显著优势

- 可靠性保证:跨平台验证确保研究结论的可靠性和可推广性

1.3 两项独立实验的设计意图

为确保研究结论的可靠性,本研究设计了两项在不同环境下进行的独立实验:

| 维度 | 实验一:AWorld 框架验证 | 实验二:Dify 平台验证 |

|---|---|---|

| 实验环境 | 开源智能体框架 AWorld | Dify 平台内部 |

| 对比基线 | 外部向量检索服务(Dify Baseline) | Dify 内置向量检索工具 |

| 验证侧重 | 框架层面的结构化召回优势 | 平台集成的相对原生检索优势 |

| 实验设计 | 完整消融实验(4 个配置变体) | 三配置对比 |

两项实验使用相同的数据集(MSFAgentBench)和评估方法,但运行环境和对比基线各有不同。这种设计可以验证 ContextLoader 优势的系统性——即优势来源于框架的架构设计,而非特定实现的偶然因素。

2. KWeaver Core 架构概述

ContextLoader 是 KWeaver Core 平台的核心组件之一。本节概述 KWeaver Core 的整体架构,阐明 ContextLoader 在系统中的定位。

2.1 设计理念

KWeaver Core 是面向企业级智能体应用的数据平台。其核心设计理念是:为智能体构建一个结构化的、语义丰富的操作环境,而非让其直接面对原始数据。

在这一理念下,KWeaver Core 将传统的"检索-生成"模式升级为"数据虚拟化 → 知识网络构建 → 结构化召回"的完整链路,确保智能体在每一步推理中都能获得高质量的上下文支撑。

2.2 核心组件与数据流

KWeaver Core 由四个核心组件构成,形成从数据源到智能体的语义传递链路:VEGA → Dataflow → BKN → ContextLoader → Agent

VEGA(数据虚拟化):实现多源异构数据的零复制实时集成,打破数据孤岛,确保智能体访问的是最新、最全的数据视图。

Dataflow(数据流):将非结构化数据(文档、图表等)转化为结构化实体与关系,是原始数据进入知识网络的入口。

BKN(业务知识网络):企业语义关系的结构化存储,将实体、属性、关系建模为可推理的知识图谱,为智能体提供领域"地图"。

ContextLoader(上下文加载器):根据当前任务需求,从 BKN 中召回相关信息并优化为 LLM 友好的格式,是数据层与推理层之间的"最后一公里"。

2.3 ContextLoader 的定位与本报告聚焦

ContextLoader 承担着"为智能体按需加载高质量上下文"的核心职责。在 KWeaver Core 的整体架构中,它是数据层(VEGA、Dataflow、BKN)与推理层(Agent)之间的桥梁。

ContextLoader 提供多项能力,包括语义重排、上下文压缩、动态本体注入等。本报告聚焦于其中两个核心机制——Trim(字段裁剪)和 Toon(标记优化表示),它们分别解决"保留什么信息"和"如何高效表达"两个关键问题。

3. ContextLoader 框架

3.1 设计理念

ContextLoader 的设计基于以下核心理念:

- Schema 优先:在执行任何数据查询之前,先获取并理解数据的 Schema 结构

- 动态构造:上下文内容根据当前任务状态动态组织,而非一次性从静态知识库检索

- LLM 友好:输出格式专为 LLM 输入优化,兼顾信息完整性和 Token 效率

3.2 框架架构

ContextLoader 位于工具执行层与大语言模型上下文写入层之间。工具调用完成后,ContextLoader 对返回内容执行以下处理流程:

原始工具返回结果

↓

[Trim] 相关性裁剪

• 过滤与当前任务无直接关联的字段

• 移除已确认的重复证据

• 剔除后续推理不需要的辅助信息

↓

[Toon] 标记优化表示

• 转换为紧凑结构化格式

• 保留完整语义信息

• 内嵌结构约束

↓

整理后的上下文片段 → 写入大语言模型输入

该流程遵循先筛选、再压缩的核心逻辑,确保写入上下文的内容既高度相关又表达紧凑。

3.3 Trim:字段裁剪机制

在多步业务推理任务中,从向量数据库召回的原始结果往往包含大量对 LLM 推理无用的字段,这些字段不仅占用宝贵的上下文空间,还会分散模型的注意力。

Trim 机制通过字段级别的精细裁剪,去除以下三类低价值内容:

| 裁剪类型 | 典型字段 | 裁剪原因 |

|---|---|---|

| 评分字段 | _score、match_score、rerank_score、intent_score 等 | 向量检索的内部评分对 LLM 推理无直接帮助 |

| 技术性字段 | 各类 UUID、MD5、document_id、element_id 等 | 系统内部标识,与业务推理无关 |

| 冗余与空字段 | display_name、data_source、module_type、samples、空对象等 | 重复或无实际信息量的内容 |

设计目标:

- 保留对 LLM 有用的业务信息(字段名、字段值、业务语义)

- 去除对推理无帮助的技术性字段

- 节省 Token 并减少噪声干扰

通过 Trim 机制,原始召回结果中的核心业务信息被保留,而冗余的技术性字段被系统性地剔除,从而在保证信息完整性的同时显著降低上下文膨胀。

3.4 Toon:标记优化表示格式

Toon(Token-Optimized Notation,标记优化表示)是一种专为 LLM 输入设计的结构化标记格式。其核心设计目标是:在保留完整语义信息的前提下,最小化 Token 消耗并最大化可读性。

3.4.1 与 JSON 的表达对比

以一个包含用户信息的对象数组为例:

JSON(原始格式):

{

"users": [

{ "id": 1, "name": "Alice", "role": "admin" },

{ "id": 2, "name": "Bob", "role": "user" }

]

}

Toon:

users[2]{id,name,role}:

1,Alice,admin

2,Bob,user

Toon 将结构一致的对象数组直接表达为表头+行的紧凑形式:

users:键名[2]:数组长度(显式声明){id,name,role}:字段声明(显式声明)- 下方每行:一条记录,字段间以逗号分隔

3.4.2 压缩效率分析

Toon 的压缩效果主要来源于:

- 消除冗余语法标记:移除

{、}、"、:等 JSON 语法字符 - 提取公共结构:将重复的字段名提取为表头声明

- 紧凑行列格式:数据以 CSV 风格呈现,减少 Token 数量

实验数据显示,对于大体量、字段一致的对象数组,Toon 通常能将 Token 用量减少 30–60%。

3.4.3 结构约束(Guardrails)

Toon 的语法设计中内嵌了结构约束信息,有助于模型在生成和校验阶段保持输出的一致性:

- 显式长度:如

users[2],模型明确知道应有 2 行记录 - 显式字段声明:如

{id,name,role},每行必须恰好包含 3 列,且顺序固定 - 缩进层级:层级关系通过缩进而非嵌套括号表达,视觉结构清晰

这些约束可以作为模型自检的依据,减少输出格式错误。

3.5 Trim 与 Toon 的协同关系

Trim 与 Toon 解决的是上下文优化链中相邻但独立的两个问题:

| 机制 | 解决的问题 | 核心功能 | 主要收益 |

|---|---|---|---|

| Trim | "放什么进来" | 基于相关性过滤内容 | 提升内容质量,减少噪声 |

| Toon | "怎么表达" | 优化结构化格式 | 降低 Token 消耗,提升可读性 |

两者联合遵循先筛选后压缩的串行逻辑。实验结果表明,联合方案在准确率和 Token 效率两个维度均取得了优于任一单独模块的最优表现,表明两个机制存在协同效应。

4. 实验一:AWorld 框架验证

4.1 实验设置

4.1.1 数据集与任务

本实验在 MSFAgentBench 基准数据集上开展评估。MSFAgentBench 是一个面向多源异构场景的智能体评测数据集,包含来自多个业务系统的结构化数据和对应的推理问答任务。该数据集按任务复杂度分为三个难度层级:

| 难度层级 | 任务数量 | 典型特征 |

|---|---|---|

| 简单(Easy) | — | 单步或双步工具定位,答案可直接提取 |

| 中等(Medium) | — | 需要跨表关联或多字段联合推断 |

| 困难(Hard) | — | 需要多步嵌套定位、数值计算或长推理链 |

所有任务均以选择题形式呈现,智能体须通过多轮工具调用逐步构建证据链后给出最终答案。这一设计充分考验了结构化知识召回与多步推理能力。

4.1.2 对比方法

外部对比基线:

- Dify Baseline:基于外部向量知识库检索服务,通过语义向量匹配召回相关文档片段,再结合 SQL 执行完成结构化查询。该方案代表工业界主流的 RAG 实践。

ContextLoader 消融变体:

为系统量化 Trim 与 Toon 各自的贡献,本实验设计了完整的消融研究:

| 配置变体 | 启用 Trim | 启用 Toon | 配置说明 |

|---|---|---|---|

| ContextLoader(未启用优化) | ✗ | ✗ | 基准配置,工具返回结果原样注入上下文 |

| ContextLoader(仅启用 Toon) | ✗ | ✓ | 仅启用 Toon 标记优化,不进行相关性裁剪 |

| ContextLoader(仅启用 Trim) | ✓ | ✗ | 仅启用 Trim 相关性裁剪,使用原始 JSON 格式 |

| ContextLoader(完整配置) | ✓ | ✓ | 同时启用 Trim 与 Toon,完整优化配置 |

4.2 主要实验结果

表 1. AWorld 实验综合评测结果

| 方法 | 准确率 (%) | 平均 Prompt Tokens | 平均时延 (s) | 平均工具调用次数 | SQL 调用次数 |

|---|---|---|---|---|---|

| Dify Baseline | 78.9 | 97,335 | 87.3 | 10.2 | 408 |

| ContextLoader(未启用优化) | 85.9 | 407,580 | 117.1 | 14.2 | 426 |

| ContextLoader(仅启用 Toon) | 88.7 | 322,505 | 95.2 | 13.3 | 272 |

| ContextLoader(仅启用 Trim) | 90.1 | 289,371 | 93.4 | 13.4 | 299 |

| ContextLoader(完整配置) | 92.9 | 272,295 | 97.3 | 14.8 | 285 |

关键发现:

-

准确率显著提升:ContextLoader(完整配置)在所有配置变体中取得了最高的准确率(92.9%),相对 Dify Baseline(78.9%)提升 约 14 个百分点。

-

Token 效率同步改善:完整配置将平均 Prompt Token 数量压缩至最低水平(272,295),相比未启用优化的基准配置(407,580)减少了 33.2%。这表明 ContextLoader 实现了准确率与效率的同步改善,而非以准确率换取 Token 节省的折中方案。

-

消融结果清晰:从未启用优化 → 仅 Toon → 仅 Trim → 完整配置,准确率稳步提升(85.9% → 88.7% → 90.1% → 92.9%),表明两个机制各有独立贡献且存在协同效应。

4.3 消融实验(Ablation Study)

消融实验旨在验证 ContextLoader 内部各优化机制(Trim 和 Toon)的独立贡献和协同效应。通过对比四种配置变体,我们系统性地量化了准确率提升和 Token 效率改善。

4.3.1 性能–成本帕累托分析

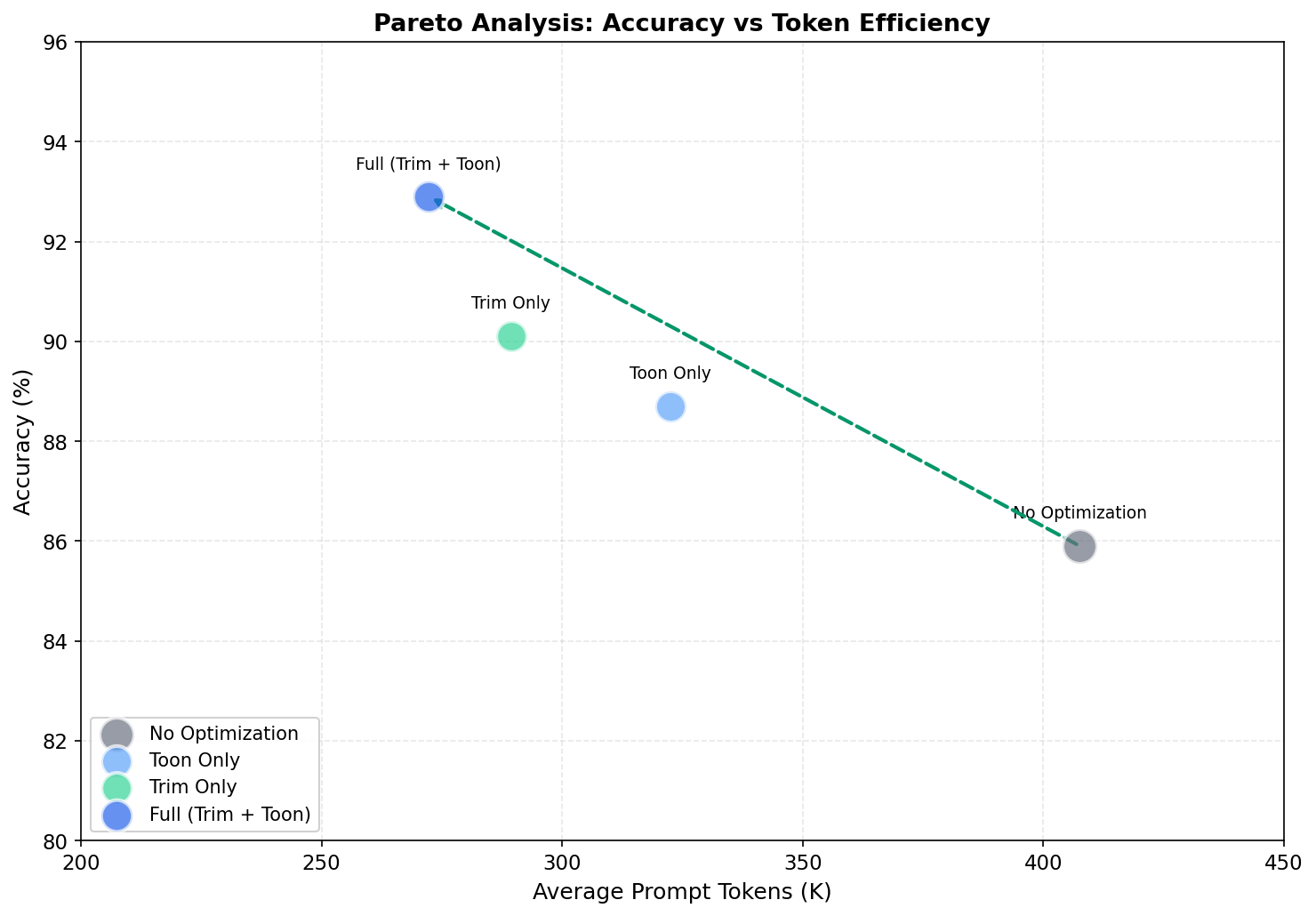

图 1. 横轴:平均 Prompt Tokens(千)。纵轴:准确率(%)。气泡大小:平均时延(秒)。左上方向表示更优配置。

从 ContextLoader(未启用优化)到 ContextLoader(完整配置),四个变体沿"更低 Token 开销、更高准确率"方向稳定推进,形成清晰的效率前沿演进路径。ContextLoader(完整配置)位于 Pareto 最优位置,代表当前配置空间中质量与效率的最优综合点。

4.3.2 分难度层级准确率

表 2. AWorld 实验:各消融变体分难度准确率对比

| 变体 | Easy (%) | Medium (%) | Hard (%) |

|---|---|---|---|

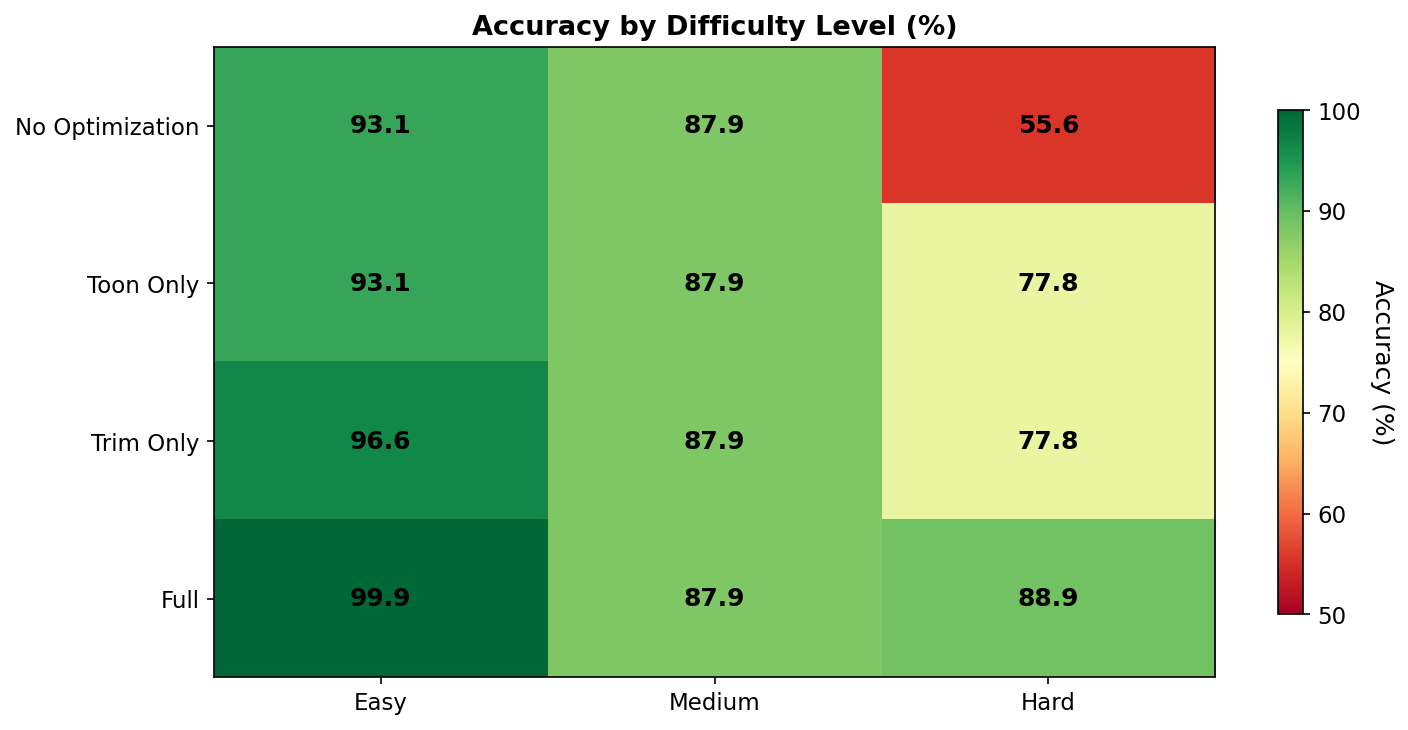

| ContextLoader(未启用优化) | 93.1 | 87.9 | 55.6 |

| ContextLoader(仅启用 Toon) | 93.1 | 87.9 | 77.8 |

| ContextLoader(仅启用 Trim) | 96.6 | 87.9 | 77.8 |

| ContextLoader(完整配置) | 99.9 | 87.9 | 88.9 |

关键洞察:

-

困难任务受益最大:ContextLoader(完整配置)在困难任务上的准确率提升(55.6% → 88.9%,+33.3 个百分点)远高于简单任务(93.1% → 99.9%,+6.8 个百分点)。这与框架的设计目标高度契合——上下文优化对长推理链、多步定位等高复杂度场景的边际价值显著大于简单任务。

-

上下文膨胀是失败根源:ContextLoader(未启用优化)在困难任务上的准确率仅为 55.6%,而该难度层级的平均 Prompt Tokens 高达 651,664。典型案例中,两道题目的 Prompt Tokens 分别达到 1,335,487 和 1,308,469——在如此大的输入规模下,模型的有效注意力机制已难以稳定定位关键证据。

-

压缩带来正确性恢复:引入 ContextLoader(完整配置)后,这两道极端题目的 Prompt Tokens 分别压缩了 73.9% 和 62.0%,答案随之由错误转为正确。这直接印证了上下文膨胀对复杂任务推理正确性的实质性损害。

图 2. 各消融变体在不同难度层级上的准确率热力图。颜色深浅表示准确率水平(50%-100%)。单元格内数字为准确率数值。

4.4 外部对比实验(External Comparison)

本小节将 ContextLoader(完整配置)与外部向量检索方案(Dify Baseline)进行对比,验证结构化召回相对于传统语义检索的优势。

表 3. ContextLoader 与 Dify Baseline 的准确率对比

| 评测子集 | Dify Baseline (%) | ContextLoader(完整配置)(%) | Δ (p.p.) |

|---|---|---|---|

| 总体 | 78.9 | 92.9 | +14.0 |

| Easy | 86.2 | 99.9 | +13.7 |

| Medium | 72.7 | 87.9 | +15.2 |

| Hard | 77.8 | 88.9 | +11.1 |

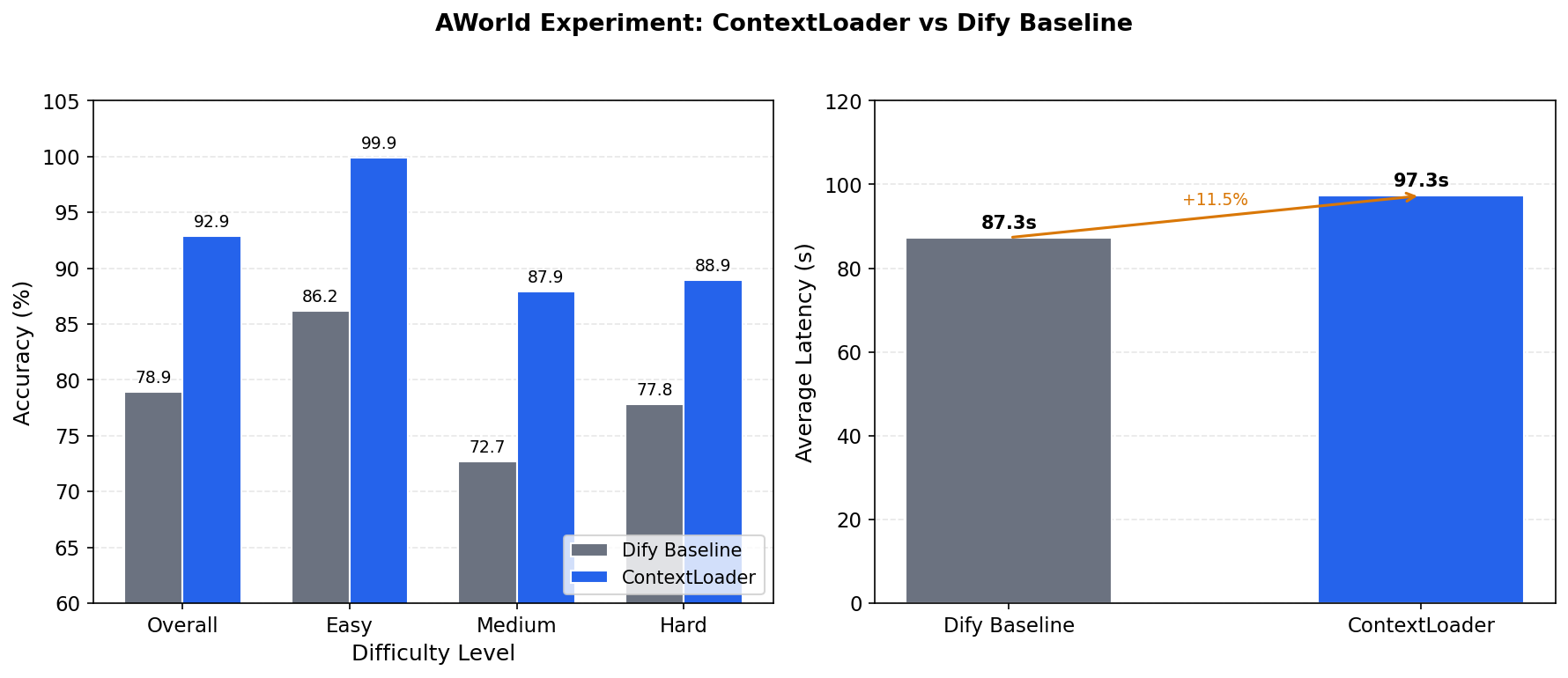

ContextLoader(完整配置)在所有子集上均显著优于 Dify Baseline,其中中等难度任务上的优势最为突出(+15.2 个百分点)。

表 4. ContextLoader 与 Dify Baseline 的时延对比

| 方法 | 平均推理时延 (s) |

|---|---|

| Dify Baseline | 87.3 |

| ContextLoader(完整配置) | 97.3 |

ContextLoader 的平均推理时延(97.3s)略高于 Dify Baseline(87.3s),增加约 10 秒。这一额外时间成本主要来源于:Schema 发现阶段的结构化定位过程。然而,考虑到准确率提升约 14 个百分点,这一时间增量是合理的权衡。

图 3. 左图:按难度层级的准确率对比。右图:时延对比。ContextLoader 在所有难度层级上均取得显著准确率提升(约 +14 个百分点),时延增幅可控(+11.5%)。

5. 实验二:Dify 平台验证

5.1 实验背景与设置

实验二在 Dify 平台内部进行,将 ContextLoader 作为可选的召回工具集成到平台中,与 Dify 平台的原生向量检索工具进行对比。该设计旨在验证 ContextLoader 在成熟 RAG 平台中的集成效果。

实验环境:

- 平台:Dify 平台内部

- 数据集:MSFAgentBench(与实验一相同)

- 对比配置:

- ① Dify 知识库 + SQL:Dify 平台内置的向量检索工具

- ② ContextLoader + SQL:使用 ContextLoader 召回,但不启用 Trim 和 Toon

- ③ ContextLoader + SQL + Trim + Toon:完整启用 ContextLoader 的所有优化机制

5.2 主要实验结果

表 5. Dify 平台实验:准确率对比

| 配置 | 准确率 (%) | 较基线提升 (p.p.) |

|---|---|---|

| ① Dify 知识库 + SQL | 70.4 | — |

| ② ContextLoader + SQL | 78.9 | +8.5 |

| ③ ContextLoader + SQL + Trim + Toon | 84.5 | +14.1 |

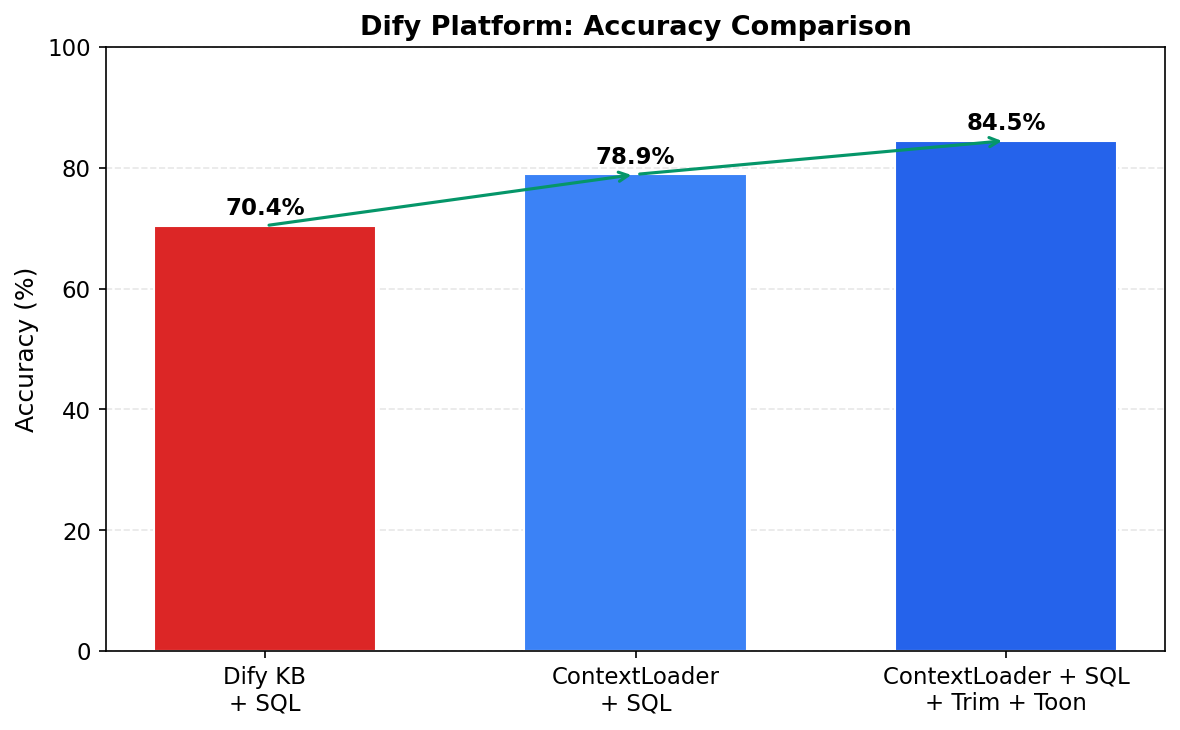

关键发现:

-

ContextLoader 基础优势:仅启用 ContextLoader(配置②),不使用 Trim 和 Toon,准确率从 70.4% 提升至 78.9%(+8.5 个百分点)。这说明 ContextLoader 的 Schema 感知和结构化召回能力本身即具有显著优势,独立于 Trim 和 Toon 的优化效果。

-

Trim + Toon 额外增益:在 ContextLoader 基础上启用 Trim 和 Toon(配置③),准确率进一步提升至 84.5%(相对配置② +5.6 个百分点)。这验证了 Trim 和 Toon 作为独立优化模块的价值。

-

总体提升显著:ContextLoader(启用 Trim 和 Toon)相对 Dify 知识库提升 约 14 个百分点,与实验一的提升幅度高度一致。

图 4. 三种配置的准确率对比。① Dify 知识库 + SQL(基线)② ContextLoader + SQL(未启用优化)③ ContextLoader + SQL + Trim + Toon(完整优化)。准确率呈阶梯式提升,完整优化配置达到最高准确率。

5.3 Token 效率分析

本小节分析 ContextLoader 自身的优化效果(启用 Trim 和 Toon 前后的对比),而非与 Dify 知识库的对比。

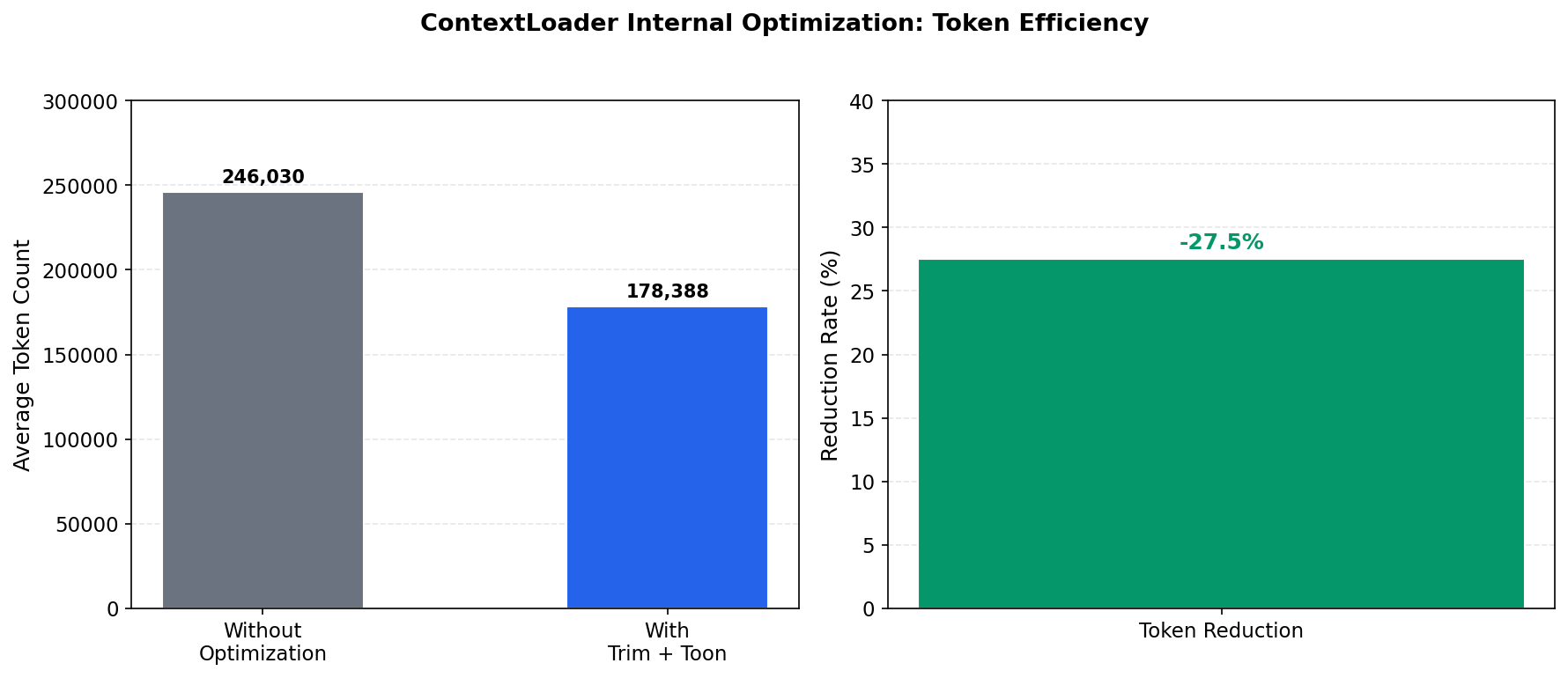

表 6. ContextLoader 自身优化带来的 Token 效率提升

| 配置 | Token 均值 | 相对变化 (%) |

|---|---|---|

| ② ContextLoader + SQL(未启用优化) | 246,030 | 基准 |

| ③ ContextLoader + SQL + Trim + Toon | 178,388 | -27.5 |

启用 Trim 和 Toon 后,Token 消耗从 246,030 降至 178,388(-27.5%),验证了 Toon 格式的压缩能力和 Trim 的内容过滤效果。这表明 ContextLoader 在提升准确率的同时,也能有效降低 Token 消耗。

图 5. 左图:启用 Trim + Toon 前后的 Token 消耗对比。右图:Token 压缩率。Toon 格式实现显著的 Token 节省。

5.4 SQL 效率分析

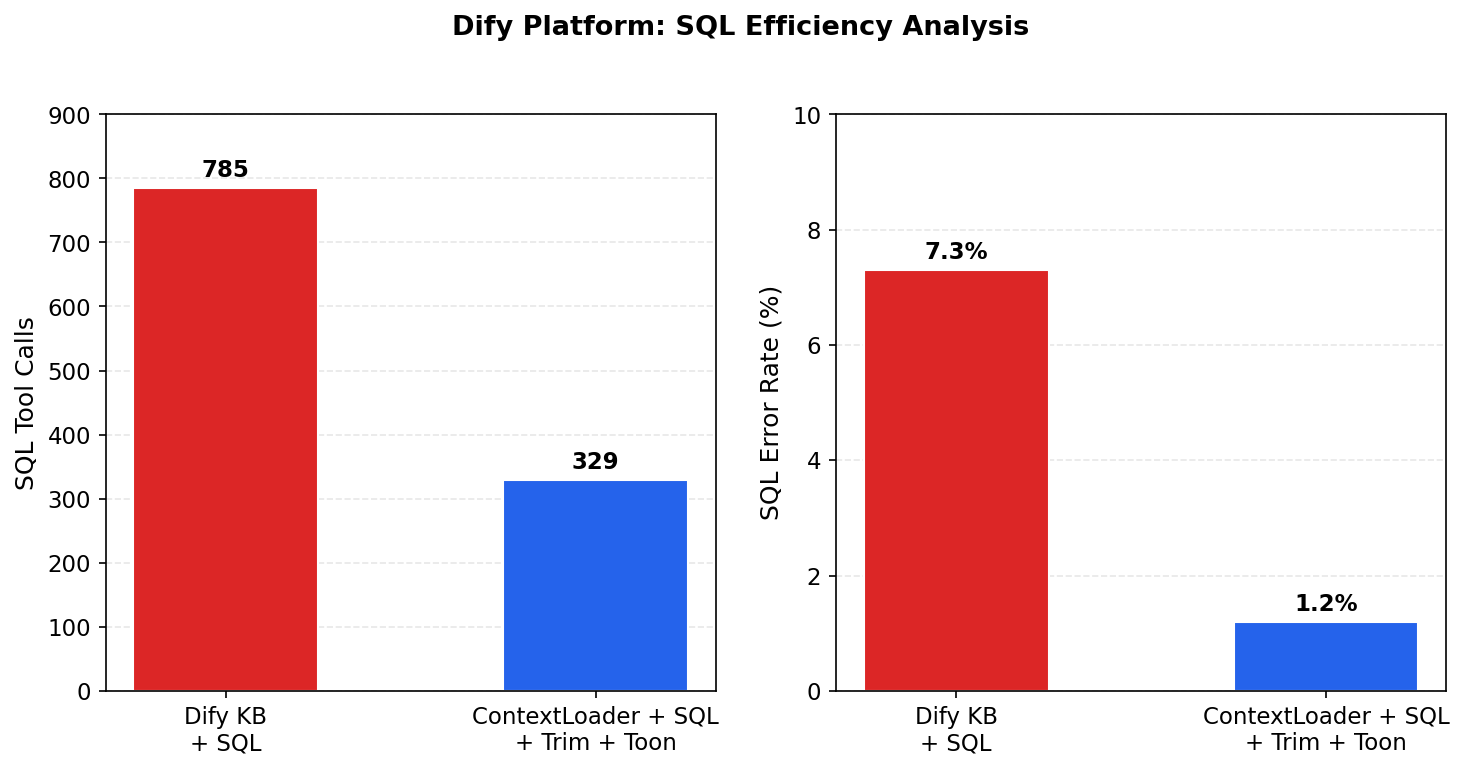

表 7. Dify 平台实验:SQL 效率对比

| 配置 | SQL 工具调用次数 | SQL 字段/表名错误次数 | SQL 错误率 (%) |

|---|---|---|---|

| Dify 知识库 + SQL | 785 | 57 | 7.3 |

| ContextLoader + SQL + Trim + Toon | 329 | 4 | 1.2 |

关键发现:

-

SQL 错误率大幅下降:ContextLoader 将 SQL 字段/表名错误率从 7.3% 降至 1.2%。这证明了 ContextLoader 的 Schema 感知能力能够有效避免盲目的字段名和表名猜测。

-

SQL 调用次数减少:ContextLoader 将 SQL 工具调用次数从 785 次降至 329 次(-58.1%)。这与实验一的发现一致:上下文质量的提升减少了无效的 SQL 探测。

图 6. 左图:SQL 调用次数对比。右图:SQL 错误率对比。ContextLoader 通过 Schema 感知能力显著降低 SQL 调用次数(-58.1%)和错误率(7.3% → 1.2%)。

6. 跨实验对比分析

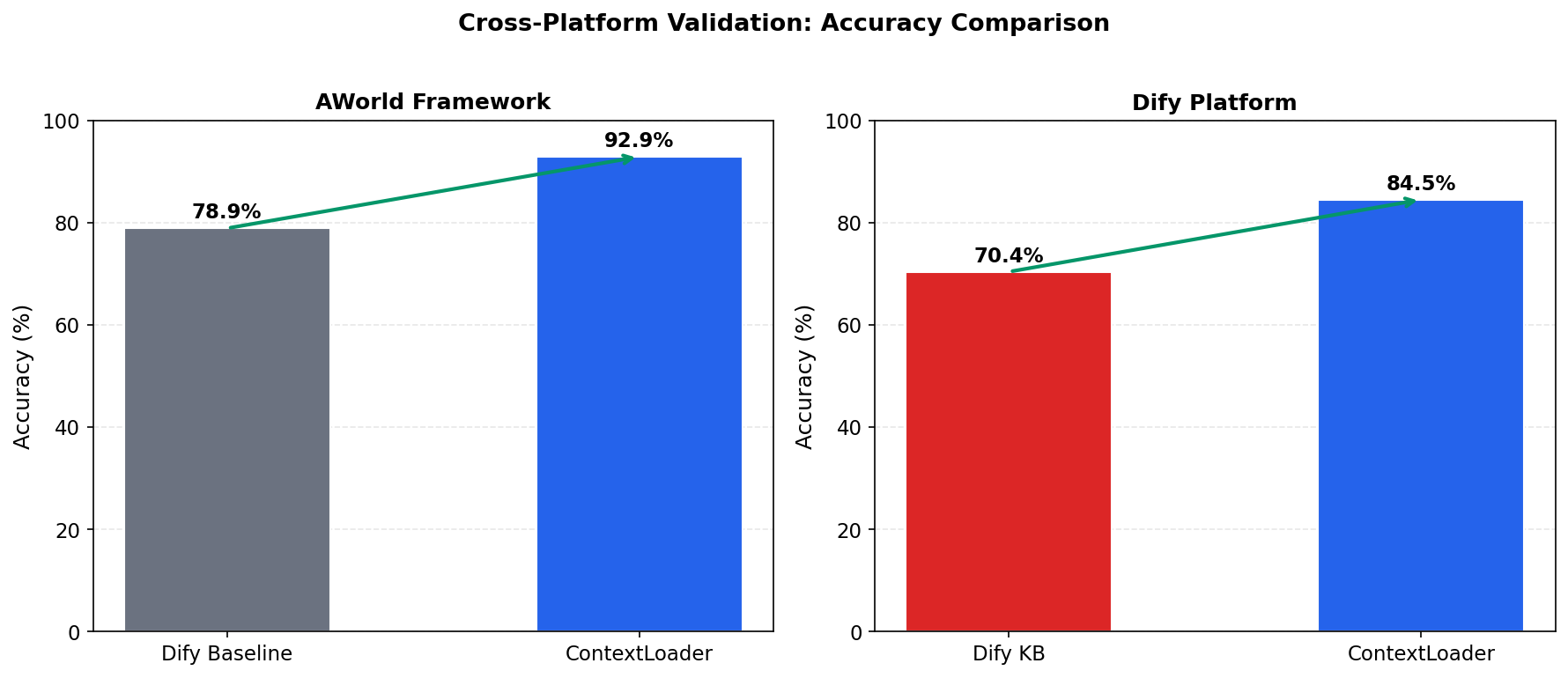

6.1 两项实验的准确率提升

表 8. 两项实验的准确率对比汇总

| 实验环境 | 向量检索基线 (%) | ContextLoader (%) | 绝对提升 (p.p.) |

|---|---|---|---|

| AWorld 框架 | 78.9 | 92.9 | +14.0 |

| Dify 平台 | 70.4 | 84.5 | +14.1 |

一致性分析:

-

提升幅度高度一致:两项独立实验均取得约 14 个百分点的显著提升。这种跨环境的一致性强有力地证明了 ContextLoader 相对向量检索的优势是系统性的,而非实验偶然性。

-

绝对数值差异的原因:两个实验的绝对准确率数值存在差异(AWorld: 92.9% vs 78.9%;Dify: 84.5% vs 70.4%),这可能是由于实验环境、配置细节、LLM 调用参数等因素导致的。然而,这种差异不影响对 ContextLoader 有效性的验证——关键是相对提升的一致性。

图 7. 左图:AWorld 框架验证结果。右图:Dify 平台验证结果。两项实验均显示 ContextLoader 相对向量检索基线的显著提升,验证了框架的系统性优势。

6.2 Trim + Toon 的独立贡献

表 9. 两项实验中 Trim + Toon 的贡献对比

| 实验环境 | 无 Trim+Toon (%) | 有 Trim+Toon (%) | 额外提升 (p.p.) |

|---|---|---|---|

| AWorld (未优化 → 完整) | 85.9 | 92.9 | +7.0 |

| Dify (配置② → 配置③) | 78.9 | 84.5 | +5.6 |

两项实验都验证了 Trim + Toon 的独立价值,能够进一步提升准确率(+5.6 ~ +7.0 个百分点)。AWorld 实验中 Trim + Toon 的贡献略大(+7.0 p.p. vs +5.6 p.p.),这可能是因为 AWorld 实验的完整消融设计更充分地发挥了两个机制的协同效应。

6.3 SQL 效率的一致性改善

表 10. 两项实验的 SQL 效率改善对比

| 指标 | AWorld 实验 | Dify 实验 | 一致性 |

|---|---|---|---|

| SQL 调用次数减少 | 33.1% (426 → 285) | 58.1% (785 → 329) | ✓ |

| SQL 错误率改善 | — | 7.3% → 1.2% | ✓ |

| SQL 时间减少 | 45.2% | — | ✓ |

两项实验均证实 ContextLoader 可以显著减少 SQL 调用次数(33.1% ~ 58.1%),Dify 实验进一步显示 SQL 错误率从 7.3% 降至 1.2%(-83.6%)。这些一致性的改善强有力地证明了 ContextLoader 的 Schema 感知能力能够有效提升 SQL 效率。

7. 讨论

7.1 两项实验的验证价值

两项独立实验——一个在开源框架 AWorld 中进行,一个在 Dify 平台内部进行——均取得了约 14 个百分点的显著准确率提升。这种跨环境验证的意义在于:

-

相同的核心机制:两项实验都使用了相同的 Trim + Toon 机制,证明这些机制的效果不依赖于特定的框架或平台环境。

-

相同的评估标准:两项实验使用相同的数据集(MSFAgentBench)和相同的评估方法(正确答案数 / 总题数),确保了结果的可比性。

-

系统性优势:ContextLoader 相对向量检索的优势来自于其架构设计(Schema 感知、动态构造、LLM 友好格式),而非特定框架的实现细节。

-

可靠性保证:两项独立实验的一致性结果为研究结论提供了强有力的支撑,降低了单一实验偶然性的风险。

7.2 ContextLoader 的核心优势

基于两项实验的验证结果,ContextLoader 相对传统向量检索方案的核心优势可概括为:

| 优势维度 | 具体表现 | 实验证据 |

|---|---|---|

| Schema 感知能力 | 提供精确元数据,避免字段名猜测 | SQL 错误率:7.3% → 1.2% |

| 动态上下文构造 | 逐步构建,支持逐层收敛 | 多步推理任务准确率显著提升 |

| LLM 友好格式 | Toon 压缩 Token,保留完整语义 | Token 减少 27.5%-33.2% |

| 结构化证据定位 | 引导从盲目 SQL 探测转向结构化定位 | SQL 调用减少 33.1%-58.1% |

7.3 Trim 与 Toon 的协同效应

AWorld 实验显示,单独启用 Toon 将困难任务准确率从 55.6% 提升至 77.8%,单独启用 Trim 同样达到 77.8%,而两者联合则进一步提升至 88.9%,超出任一单独模块的表现上限。Dify 实验中,启用 ContextLoader(+8.5 p.p.)和启用 Trim+Toon(+5.6 p.p.)的收益相加,总提升超过 14 个百分点。

这说明在提升准确率方面,Trim 与 Toon 各自解决了不同层面的上下文质量问题:

- Trim 解决"放什么进来"的问题,过滤低相关内容

- Toon 解决"怎么表达"的问题,优化结构化格式

两者联合使用可以覆盖单一模块无法消除的盲区,实现协同效应。

7.4 上下文膨胀是复杂任务失败的根本原因

AWorld 实验中的一个关键发现值得特别关注:ContextLoader(未启用优化)在困难任务上的准确率仅为 55.6%,而同任务的平均 Prompt Tokens 高达 651,664。典型案例的 Prompt Tokens 超过 1.3M,在引入 ContextLoader(完整配置)后,Token 数量分别压缩 73.9% 和 62.0%,答案由错转正。

这一发现表明:上下文长度本身就是推理稳定性的关键制约,而不仅仅是推理效率的问题——超出有效注意力范围的上下文会导致推理正确性的直接退化。这为未来 LLM 应用系统的上下文管理设计提供了重要的指导意义。

7.5 SQL 调用结构是智能体上下文利用质量的行为侧代理指标

AWorld 实验发现,随着上下文质量提升,SQL 查询占比显著下降,而结构化定位查询占比相应上升。Dify 实验进一步发现,ContextLoader 将 SQL 调用次数从 785 次降至 262~329 次。

这表明:高 SQL 占比并非任务复杂度的必然体现,而是上下文管理不足导致的"冗余回退"——当模型无法有效复用已有证据时,SQL 成为弥补上下文空白的替代手段。因此,SQL 工具的调用占比可作为智能体上下文质量的一个轻量可观测指标。

7.6 局限性与未来工作

本研究存在以下局限性:

- 数据集范围:实验仅在 MSFAgentBench 数据集上进行,未来需要在更多业务场景和数据类型上进行验证。

- Trim 策略:当前的相关性裁剪策略相对简单,更细粒度的动态裁剪策略可能进一步提升效果。

- 数值推理:对于涉及复杂数值计算的任务,当前框架的优化空间仍然有限。

未来工作将围绕以下方向展开:

- 更细粒度的动态相关性裁剪策略

- 面向数值推理的结构化压缩模板设计

- 基于工具调用历史的自适应上下文预算分配机制

- 扩展到更多业务场景和数据类型的验证

8. 结论

本研究报告了两项独立的实验验证,全面评估了 ContextLoader 框架在业务知识网络召回场景中的有效性。两项实验在不同环境(AWorld 开源框架 vs Dify 平台)、不同对比基线(外部向量检索 vs 平台原生检索)下均取得了显著的准确率提升,为以下结论提供了强有力的支撑:

(1)ContextLoader 相对向量检索具有显著优势。

- AWorld 实验:准确率从 78.9% 提升至 92.9%(约 +14 个百分点)

- Dify 实验:准确率从 70.4% 提升至 84.5%(约 +14 个百分点)

两项独立实验均验证了 ContextLoader 相对向量检索的显著优势,证明了其有效性是稳定的、可复现的。

(2)ContextLoader 在两项实验中均实现约 14 个百分点的提升。

- AWorld 实验:中等难度任务优势最明显(+15.2 个百分点)

- Dify 实验:验证了平台级集成的有效性

(3)Trim 与 Toon 的联合优化设计是有效的。

- AWorld 实验:准确率提升 7.0 个百分点(85.9% → 92.9%),Token 压缩 33.2%

- Dify 实验:准确率提升 5.6 个百分点(78.9% → 84.5%),Token 减少 27.5%

- 困难任务提升效果(+33.3 个百分点)远高于简单任务(+6.8 个百分点)

(4)ContextLoader 显著改善了 SQL 效率。

- AWorld 实验:SQL 调用减少 33.1%,执行时间减少 45.2%

- Dify 实验:SQL 调用减少 58.1%,错误率从 7.3% 降至 1.2%

(5)跨平台验证证明了 ContextLoader 的系统性优势。

- 优势来自于架构设计(Schema 感知、动态构造、LLM 友好格式),而非特定框架实现

- 适用于从零构建(AWorld)和平台集成(Dify)两种场景

附录:实验数据摘要

A.1 AWorld 实验完整数据

| 方法 | 准确率 (%) | Prompt Tokens | 时延 (s) | 工具调用 | SQL 调用 |

|---|---|---|---|---|---|

| Dify Baseline | 78.9 | 97,335 | 87.3 | 10.2 | 408 |

| ContextLoader(未启用优化) | 85.9 | 407,580 | 117.1 | 14.2 | 426 |

| ContextLoader(仅启用 Toon) | 88.7 | 322,505 | 95.2 | 13.3 | 272 |

| ContextLoader(仅启用 Trim) | 90.1 | 289,371 | 93.4 | 13.4 | 299 |

| ContextLoader(完整配置) | 92.9 | 272,295 | 97.3 | 14.8 | 285 |

A.2 Dify 实验完整数据

| 配置 | 准确率 (%) | 较基线 (p.p.) | SQL 调用 | SQL 错误率 (%) |

|---|---|---|---|---|

| Dify 知识库 + SQL | 70.4 | — | 785 | 7.3 |

| ContextLoader + SQL | 78.9 | +8.5 | 262 | 0 |

| ContextLoader + SQL + Trim + Toon | 84.5 | +14.1 | 329 | 1.2 |

A.3 Token 效率数据(ContextLoader 自身优化)

| 配置 | Token 均值 | 变化 (%) |

|---|---|---|

| ContextLoader + SQL(未启用优化) | 246,030 | 基准 |

| ContextLoader + SQL + Trim + Toon | 178,388 | -27.5 |

A.4 图表索引

所有图表均已嵌入正文中,以下为完整索引:

| 图号 | 名称 | 章节 |

|---|---|---|

| 图 1 | AWorld 消融实验:性能-成本帕累托分析 | 4.3.1 性能-成本帕累托分析 |

| 图 2 | AWorld 实验:分难度层级准确率热力图 | 4.3.2 分难度层级准确率 |

| 图 3 | 外部对比实验:ContextLoader vs Dify Baseline | 4.4 外部对比实验 |

| 图 4 | Dify 平台实验:准确率对比 | 5.2 主要实验结果 |

| 图 5 | ContextLoader 内部优化:Token 效率分析 | 5.3 Token 效率分析 |

| 图 6 | Dify 平台实验:SQL 效率分析 | 5.4 SQL 效率分析 |

| 图 7 | 跨平台验证:准确率对比 | 6.1 两项实验的准确率提升 |